全城7x24小时免费上门,您的生活服务帮手

IT之家5月29日消息,DeepSeekR1模型昨日宣布完成小版本升级,当前版本为DeepSeek-R1-0528。用户通过官方网站、App或小程序进入对话界面后,开启“深度思考”功能即可体验最新版本。API也已同步更新,调用方式不变。

今日晚间,深度求索官方公布了DeepSeek-R1-0528更新的详细升级内容,IT之家附具体介绍如下:

深度思考能力强化

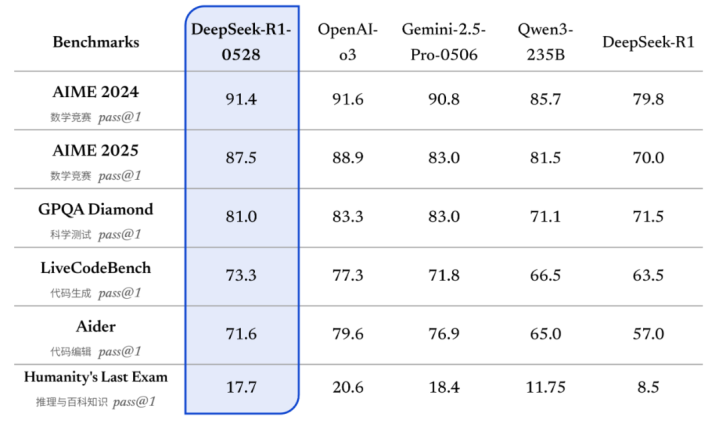

DeepSeek-R1-0528仍然使用2024年12月所发布的DeepSeekV3Base模型作为基座,但在后训练过程中投入了更多算力,显著提升了模型的思维深度与推理能力。更新后的R1模型在数学、编程与通用逻辑等多个基准测评中取得了当前国内所有模型中首屈一指的优异成绩,并且在整体表现上已接近其他国际顶尖模型,如o3与Gemini-2.5-Pro。

相较于旧版R1,新版模型在复杂推理任务中的表现有了显著提升。例如在AIME2025测试中,新版模型准确率由旧版的70%提升至87.5%。

这一进步得益于模型在推理过程中的思维深度增强:在AIME2025测试集上,旧版模型平均每题使用12Ktokens,而新版模型平均每题使用23Ktokens,表明其在解题过程中进行了更为详尽和深入的思考。

同时,官方蒸馏DeepSeek-R1-0528的思维链后训练Qwen3-8BBase,得到了DeepSeek-R1-0528-Qwen3-8B。该8B模型在数学测试AIME2024中仅次于DeepSeek-R1-0528,超越Qwen3-8B(+10.0%),与Qwen3-235B相当。深度求索官方认为,DeepSeek-R1-0528的思维链对于学术界推理模型的研究和工业界针对小模型的开发都将具有重要意义。

其他能力更新

幻觉改善:新版DeepSeekR1针对“幻觉”问题进行了优化。与旧版相比,更新后的模型在改写润色、总结摘要、阅读理解等场景中,幻觉率降低了45~50%左右,能够有效地提供更为准确、可靠的结果。

创意写作:在旧版R1的基础上,更新后的R1模型针对议论文、小说、散文等文体进行了进一步优化,能够输出篇幅更长、结构内容更完整的长篇作品,同时呈现出更加贴近人类偏好的写作风格。

工具调用:DeepSeek-R1-0528支持工具调用(不支持在thinking中进行工具调用)。当前模型Tau-Bench测评成绩为airline53.5%/retail63.9%,与OpenAIo1-high相当,但与o3-High以及Claude4Sonnet仍有差距。

此外,DeepSeek-R1-0528在前端代码生成、角色扮演等领域的能力均有更新和提升。

API更新

API已同步更新,接口与调用方式保持不变。新版R1API仍支持查看模型思考过程,同时还增加了FunctionCalling和JsonOutput的支持。

官方对新版R1API中max_tokens参数的含义做了调整:现在max_tokens用于限制模型单次输出的总长度(包括思考过程),默认为32K,最大为64K。请API用户及时调整max_tokens参数以防输出被提前截断。

R1模型的使用方法详见API指南:

本次R1更新后,官方网站、小程序、App端和API中的模型上下文长度仍为64K。如果用户对更长的上下文长度有需求,可以通过其他第三方平台调用上下文长度为128K的开源版本R1-0528模型。

模型开源

DeepSeek-R1-0528与之前的DeepSeek-R1使用同样的base模型,仅改进了后训练方法。私有化部署时只需要更新checkpoint和tokenizer_config.json(toolcalls相关变动)。模型参数为685B(其中14B为MTP层),开源版本上下文长度为128K(网页端、App和API提供64K上下文)。

DeepSeek-R1-0528模型权重下载参考:

ModelScope:

Huggingface:

与旧版本的DeepSeek-R1保持一致,此次开源仓库(包括模型权重)仍然统一采用MITLicense,并允许用户利用模型输出、通过模型蒸馏等方式训练其他模型。

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51

2025-05-30 06:03:51